En un mundo donde los costos asociados a la inteligencia artificial (IA) son cada vez más elevados, RouteLLM surge como una solución innovadora para optimizar esos gastos sin sacrificar la calidad. Esta herramienta permite reducir hasta un 85% de los costos asociados al uso de modelos de lenguaje grande (LLM), lo que la convierte en una opción esencial para empresas y desarrolladores que buscan equilibrar calidad y presupuesto en sus proyectos de IA. A continuación, exploraremos qué es RouteLLM, cómo funciona y cómo puede ayudarte a ahorrar en tus implementaciones de IA.

¿Qué es RouteLLM?

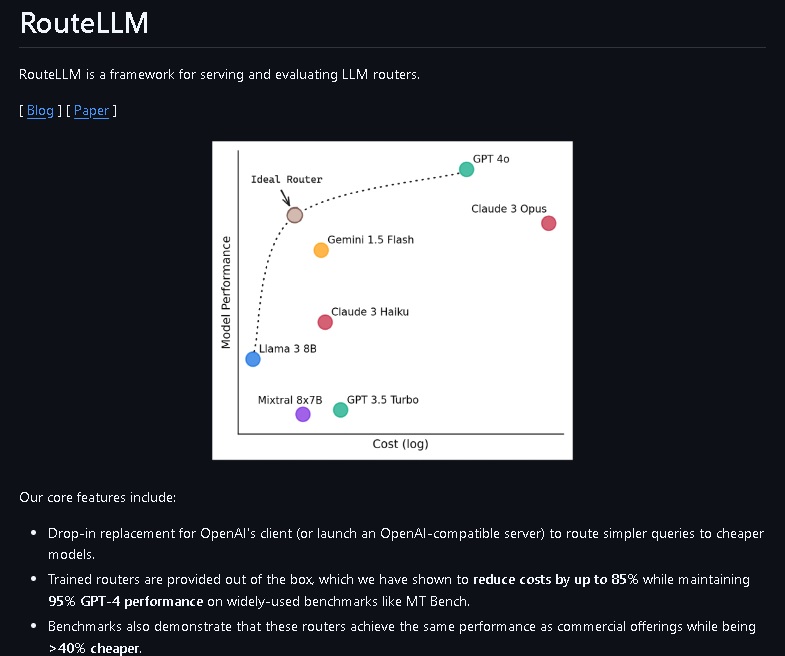

RouteLLM es una plataforma de enrutamiento de modelos de lenguaje grande (LLM) que permite redirigir consultas entre distintos modelos de IA de forma que se optimicen los costos sin perder precisión en los resultados. Utiliza un sistema que permite combinar modelos de alto rendimiento (como GPT-4) con modelos más ligeros y económicos. De esta manera, las consultas más simples son dirigidas a los modelos menos costosos, mientras que las más complejas se mantienen en los modelos más potentes.

La principal ventaja de RouteLLM es que automatiza este proceso de enrutamiento, de modo que los usuarios no necesitan gestionar manualmente qué modelo utilizar para cada tarea. El sistema lo hace automáticamente, garantizando siempre una respuesta rápida y con un coste optimizado.

¿Para qué sirve RouteLLM?

RouteLLM está diseñado para resolver el problema del alto costo de los modelos de lenguaje de gran escala. Si bien modelos como GPT-4 ofrecen resultados de alta calidad, su uso constante puede resultar costoso, especialmente para empresas que necesitan realizar consultas masivas o en proyectos de largo plazo.

La herramienta resuelve este problema mediante el enrutamiento inteligente de las consultas a los modelos adecuados, dependiendo de la complejidad de la tarea:

- Consultas simples: Son dirigidas a modelos más económicos sin perder calidad en la respuesta.

- Consultas complejas: Son procesadas por modelos de alta gama como GPT-4, que garantizan una mayor precisión.

Esto no solo permite un ahorro significativo, sino que también optimiza la eficiencia de los proyectos de IA, manteniendo la calidad y reduciendo los tiempos de espera.

Capacidades / Funciones destacadas

| Característica | Descripción |

|---|---|

| Reducción de costos | Ahorra hasta un 85% en comparación con el uso exclusivo de modelos de alto rendimiento, sin comprometer la calidad de los resultados. |

| Ruteo inteligente | Determina automáticamente qué modelo utilizar para cada consulta, en función de su complejidad, optimizando el costo por respuesta. |

| Compatibilidad con múltiples modelos | Compatible con diversos modelos de IA, incluyendo opciones de código abierto y de pago, lo que permite una flexibilidad total en la elección de herramientas. |

| Configuración sencilla | Fácil de integrar con plataformas como OpenAI, utilizando configuraciones mínimas y acceso mediante API. |

Planes y precios

RouteLLM ofrece una plataforma gratuita para que los usuarios puedan probar su funcionalidad, con opciones de pago según el uso. Actualmente, no se encuentran precios específicos para planes premium, pero la herramienta es de código abierto, lo que significa que es accesible a cualquier persona que quiera implementarla en sus proyectos.

| Plan | Descripción |

|---|---|

| Gratis | Acceso completo al sistema de enrutamiento LLM sin costo. |

| De pago | Opción disponible para empresas que requieren más capacidad de procesamiento y personalización. |

Para más detalles sobre el uso de RouteLLM, puedes visitar su repositorio en GitHub.

Preguntas frecuentes (FAQ)

- ¿Cómo puedo integrar RouteLLM en mi proyecto?

Para integrar RouteLLM, solo necesitas instalar la librería desde PyPI o clonar el repositorio desde GitHub. La configuración es rápida y sencilla. - ¿Cuánto ahorro realmente usando RouteLLM?

Puedes ahorrar hasta un 85% en los costos de uso de LLM, especialmente si gestionas grandes volúmenes de consultas o si trabajas con modelos como GPT-4. - ¿Qué modelos puedo usar con RouteLLM?

RouteLLM es compatible con una amplia variedad de modelos, tanto de código abierto como comerciales, como GPT-4 y Mixtral. - ¿RouteLLM es fácil de configurar?

Sí, es fácil de integrar en proyectos ya existentes. Solo necesitas establecer tus claves API y seleccionar los modelos que quieras usar. - ¿Es RouteLLM adecuado para proyectos a gran escala?

Absolutamente. Su capacidad para enrutar consultas a modelos más económicos cuando es posible lo convierte en una opción ideal para proyectos grandes que buscan optimizar sus costos. - ¿RouteLLM soporta modelos locales?

Sí, puedes usar RouteLLM para enrutar consultas entre modelos locales, lo que te permite mantener el control total sobre tu infraestructura de IA.

Conclusión

RouteLLM es una herramienta poderosa y flexible que promete revolucionar la forma en que las empresas gestionan los costos de la inteligencia artificial. Gracias a su sistema de enrutamiento eficiente, puedes reducir significativamente los gastos sin perder la calidad de los resultados. Si estás buscando una forma de optimizar tu presupuesto en proyectos de IA, RouteLLM es una opción que definitivamente debes considerar.